“几乎天天有人来找我卖英伟达A100芯片”,一位芯片贸易商近期向芯世相反映。

ChatGPT爆火之后,听说英伟达 A100的市场价已经从6万炒到了9万了,还有人打着“京东9万3而本店只要9万”的旗号“优惠”出A100。去年年底,A100还被美国禁售中国,价格水涨船高。大家眼中稀缺的A100真有市场吗?

阅读本文,你将了解:

1、英伟达的A100 GPU为什么涨价了?

2、谁在为A100 买单?

3、市场价9万一块的A100,真的有需求吗?

01

被禁售、阉割的A100

价格水涨船高

ChatGPT爆火,它超算集群背后用的英伟达高端GPU也火了。

OpenAI使用了约1万颗英伟达GPU来训练GPT-3.5模型,为了进一步满足服务器需求,OpenAI 使用的英伟达GPU数量已经增加到约2.5万个,机构预计这个数量将超过3万个。据外媒报道,如果谷歌需要将该技术应用到每一次的搜索中,则需要部署超过410万个英伟达GPU。就算是国内初出茅庐的类ChatGPT系统MOSS,也采用了8个英伟达的A100 GPU。

ChatGPT带来了A100等高端GPU需求的增长,而去年8月底,在这类芯片上我们又被“卡”了脖子。

美国通过一纸禁令,禁止英伟达向中国出售包括最新的H100和A100在内的高端GPU。这些产品系当前领先技术的新一代GPU芯片,国产替代难度大,而市面上现存的A100均是存货,据说这些A100的剩余使用寿命还有约4-6年,如果上量,应该很快会耗尽。

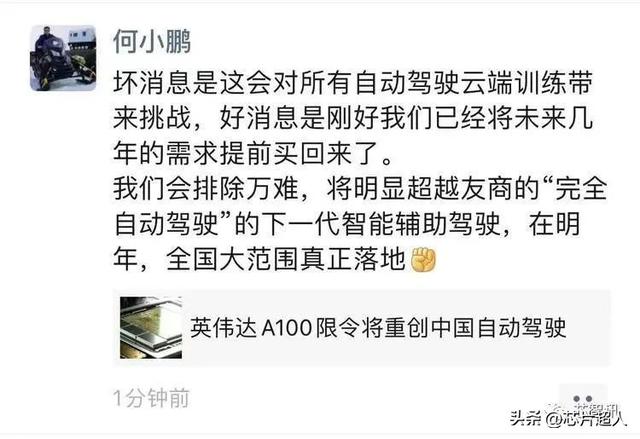

此前困于汽车芯片的小鹏汽车CEO何小鹏又为缺高端显卡发声,称英伟达 A100/H100的限制令“会对所有自动驾驶云端训练带来挑战”,好消息是:小鹏汽车刚好已经将未来几年的需求提前买回来了。

小鹏汽车有提前备货,但禁售令对自动驾驶或其他AI领域的中国企业有多大影响,就不得而知了。在市面上,A100因为变成稀缺品,价格开始水涨船高,从官方的1万美元/枚,约合人民币7万,涨至8万、9万元,快要到10万一枚。即便去年年底英伟达推出A100“阉割版”(带宽被限制)——A800显卡,于2022年Q3投入生产,在中国依然遭遇严重缺货。

据了解,A800京东官网定价超过8万元/枚,甚至超过A100官方定价。3月初,有云厂商人士接受财经十一人采访表示,A800实际售价甚至高于10万元/枚,价格还在持续上涨。A800目前在浪潮、新华三等国内服务器厂商手中是稀缺品,一次只能采购数百片。

来源:财经十一人

A100和A800在中国如此缺货,禁令对英伟达的潜在影响高达4亿美元,英伟达没闲着,一边催上游代工厂发货,增加订单,一边争取美国禁令的宽限时间。

去年9月,传英伟达为满足大陆客户激增的需求,对台积电下了“超级急件”订单,计划在缓冲期之内完成更多的交付。据悉,英伟达要求台积电提前生产了原订于2023年出货的部分产品,总量约5000片晶圆,交期从5-6个月压缩到了2-3个月,此前预计最快10月底至11月初开始陆续交货。随着近期ChatGPT大热,3月有业内人士透露,英伟达还向台积电增加了A100、H100、A800 GPU订单。

通过与美国官方斡旋,除了将出口限制宽限延后至2023年3月,在2023年9月1日前,可以通过英伟达的香港公司继续履行和运输A100和H100芯片订单。

英伟达此前靠“挖矿”赚得盆满钵满,如今“挖矿时代”终结,英伟达又站在人工智能这一新风口上,CEO黄仁勋宣称人工智能的“iPhone时刻”已经到来,或许在A100这样的高端显卡市场,又会迎来和几年前类似的需求暴涨?

A100作为H100的前代产品,虽然不是最新产品,但在人工智能领域依然能打。老黄在近期采访中还多次推销A100显卡,在他看来,想要进入人工智能领域,购买A100就是最好的选择。

2020年5月14日晚,英伟达创始人CEO黄仁勋以线上发布的形式,从自家厨房中“搬”出了A100 GPU,黄仁勋表示这是英伟达8代GPU史上最大的一次性能飞跃。这款高端显卡集AI训练和推理于一身,适用于自动驾驶、高端制造、医疗制药等场景,其AI训练和推理性能相比于前代V100提升了高达20倍。

这代DGX A100 AI系统包含8块A100 GPU

ChatGPT主要就是用英伟达的A100进行训练,这款显卡也成为了最抢手的产品之一。某宝上关于A100 显卡商品的问答中,就有购买者表示自己买来做深度学习,训练模型。

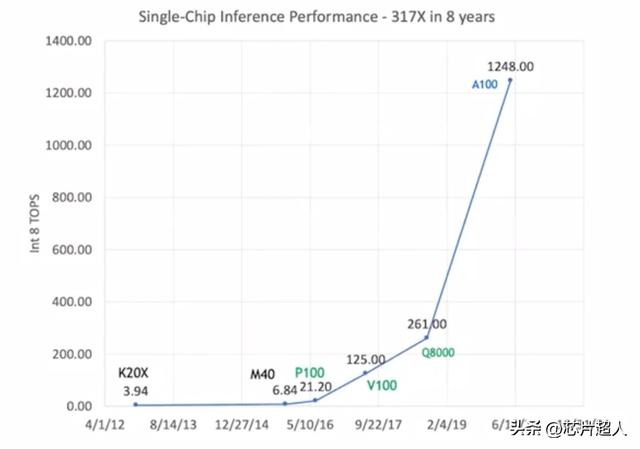

在摩尔定律最好的十年,AI 处理速度提高了100万倍,而到了黄仁勋提出的“黄氏定律”(Huang’s Law),从2012年的K20X到2020年的A100,英伟达的GPU推理性能提高到原来的317倍,远超摩尔定律的发展速度。

GPU推理性能提升

GPU或将推动AI性能实现逐年翻倍。英伟达与数据科学家、AI 研究人员合作开发新模型,在整个跨度内,成功使大型语言模型处理速度提高了一百万倍。

游戏、云计算、加密货币、元宇宙、ChatGPT……不管大家要挖金矿、银矿还是铁矿,站在什么样的风口上,如果说英伟达是产业上游的“卖铲人” ,那么它的A100、H100等高端显卡,对各大企业来说就是最高效,最省力的“铲子”。

02

A100

大厂们的“必需品”

云服务、数据中心、超算、自动驾驶平台、元宇宙平台等大厂是使用A100的主力军,它们面对的是海量数据,讲究极致的计算性能是对芯片的需求之一,而往往它们需要的不只是一块GPU。

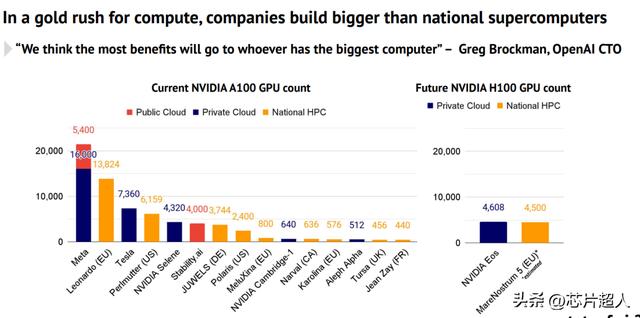

Stateof.ai去年发布了一份人工智能状况报告,对当前各企业和机构拥有的A100和H100数量进行了统计。

如上图显示,排名前三位的分别是Meta(21400)、欧洲超算Leonardo(13824)和特斯拉(7360)。

Meta在去年宣布建造全球最快的AI超算“RSC”,包含16000颗A100 GPU,目的即是为了元宇宙平台。元宇宙概念是2022年引爆互联网及科技产业的热词,元宇宙本质上是对现实世界的虚拟化及数字化的过程。它本身不是新技术,但却融合了包括5G、云计算、AI、虚拟现实、物联网、人机交互等一大批现有的尖端技术。

来自意大利CINCA研究中心的Leonardo超级计算机使用了近14000颗A100 GPU,被称为世界上最强大的AI系统。超级计算机多用于国家高科技领域和尖端技术研究,由于其集功能最强、运算速度最快、存储容量最大的优势集一身,在气候、材料学、生物医药、先进制造、航空航天等领域有着广泛的用途,可以模拟大气、气候和海洋,对地质灾害进行预测,也可以对药物研制、生化反应进行模拟,大幅缩短研发时间。

总之,超算是你平常看不见摸不着甚至鲜有耳闻,但却在一个隐秘角落为科技发展发光发热的劳模。

特斯拉在CVPR 2021(国际计算机视觉与模式识别会议)上公布了内部用于训练Autopilot与自动驾驶深度神经网络的超级计算机。这个集群使用了720个节点的8个NVIDIA A100 GPU(共5760个GPU)。

我们知道特斯拉是纯视觉自动驾驶的推崇者,在没有激光雷达提供3D空间数据的情况下,特斯拉仅依靠摄像头提供的2D图像就能完成现有的辅助驾驶系统,这背后是上百万台特斯拉,每天在路上行驶获得的海量图像数据,以及特斯拉为此构建的神经网络模型。

除了这三位外,榜单其余部分均是公有云、私有云和国家超算。

国内企业部分,基于有限的资料,能大量使用A100的大致分为三类:一类是阿里、百度、腾讯(俗称BAT)等云服务商,另一类是浪潮、联想、新华三等系统集成商,第三类是像小鹏等自动驾驶车企,但从整体规模来看,海外明显占据上风。

从以上企业所处领域,我们大致归纳出A100等训练芯片主要应用的场景:云计算、超算、深度学习模型训练、自动驾驶、元宇宙、机器视觉等,深入的领域包括:工业、医疗、金融、气候、农业、能源、消费、汽车、半导体等。这些场景和领域往往面临着超大规模的密集型数据、海量存储及高性能计算。

它们都需要不止一块强悍的芯片,强到连英伟达竟也成为了自己供应商的供应商。

黄仁勋在今年GTC演讲中宣布,新发布的基于 GPU 的计算光刻软件库 cuLitho,用于芯片制造中最复杂、最昂贵的光刻环节,使用它之后计算光刻速度可以提升至原来的 40 倍,光掩膜产能提升 3 至 5 倍,电力消耗减少为当前的九分之一。黄仁勋说,cuLitho 将辅助芯片制程向 2 纳米及更先进迈进。

跟英伟达一起研发该技术的三家公司分别是台积电、ASML 和 Synopsys。台积电帮英伟达代工生产 GPU 芯片,是它最重要的供应商之一。ASML 和 Synopsys分别是全球光刻机和 EDA 龙头,都处于整个半导体产业最上游环节。现在三者都要用英伟达的 GPU 和技术平台。

这意味着能用A100的玩家们并非等闲之辈,能用得到A100的地方也并非是通用化的场景,这就造就了A100这类芯片独特的身份,它的应用范围和使用人群非常的聚拢和突出。

03

真有那么多需求吗?

让我们从海内外终端大厂回到国内现货市场,A100市场价涨至8万、9万,谁会去买单?真有那么多需求吗?

相关从业者对芯世相表示,虽然卖家都在涨价出A100,但成单估计很少。

首先,非刚需,成本高昂,国内能“烧”得动A100的企业寥寥无几。

企业要想玩AI,得经历训练和推理两个环节,一个相当于在校学习,一个是通过所学知识去应对考试,不断精进。没有训练,就不会有推理。

训练,讲究绝对的算力性能。这里我们分成两种情况:一种是以GPU为主搭建算力基础,另一种以AI芯片为主。

早些年,进入AI领域的初创企业可以凭借如百度飞浆这类的深度学习开源平台进行研发,但对于生成式AI这类预训练大模型难度极高,大多数创业者哪怕是国际大厂能够将其商业化的也是寥寥无几。

这类模型需要海量的数据、算法、算力的支撑,高投入和高门槛使得很多企业退避三尺。微软直言,给OpenAI打造的超算集群,光建设成本就不止几亿美元。且国内并非所有企业都用得起A100这类的高端显卡,目前国内云厂商主要用的是英伟达中低性能产品如A10,拥有超1万枚GPU的企业不超一只手,拥有1万枚A100的企业只有一家。

除了价格昂贵,维修费也惊人,且保修一般只有一年。对于一般企业而言,如果想要算力的支撑,可以寻求云服务提供商,调用它们的云计算能力,或者去租借高端GPU来完成某个项目的开发。

对于有实力的大厂而言,随着SoC技术的发展,GPU未必是唯一选择。从上图可以看到,各家科技公司在训练AI大模型上所用的芯片也并非是A100,像百度、阿里巴巴、谷歌等都是用的自研AI芯片。

以百度和华为为例,2021年发布的当时全球最大中文单体模型鹏城 – 百度·文心(ERNIE 3.0 Titan),训练基于鹏城云脑Ⅱ,背后是华为AI训练集群Atlas 900的支撑,将数千颗昇腾910 AI处理器互联,每颗昇腾910 AI处理器内置32个达芬奇AI Core,单芯片提供比业界高一倍的算力。

鹏城云脑当时训练规模更大的盘古模型,约有2600亿个参数,只花了接近一个月左右,整个成本算下来是GPT-3 的1/10甚至更小,当时GPT-3 1000多亿参数规模模型花了几百万美元,用时两三个月。

综合来看,训练人工智能模型,特别是预训练大模型不光是人才和资源的大量投入,还是一个技术积累的工作,一般企业没有数据训练的基础和经验,也难以承受高昂的成本。所以,这仍是大厂间的竞争,小厂更适合接入大厂的模型,将应用落地,如AI绘画、AI视频创作等,赋能C端。

推理,对算力不会有高要求,更注重综合指标,比如能耗算力、时延、成本等。

国内很多大语言模型都是基于海外开源的数据和软件,如果只是套用现成的模型进行推理的话,A100的性能又显得“溢出”,非必需品。

对个人来说,A100是专业显卡,并不是游戏级别。据了解,用几万元的专业显卡打游戏也比不上1万多的3090显卡,玩游戏性价比差。可能只有少数针对AI的专业人士和发烧友会去购买,但这部分的需求真的微乎其乎。

无论是训练还是推理,最重要的还是契合企业的业务发展。国内这波AI热潮,其实细观各互联网大厂的布局,我们会发现它们各有侧重点。字节偏重于AI+内容,阿里、京东等偏向AI+营销,腾讯则以广告为主,它们并非盲目入局,一窝蜂地进入ChatGPT的应用领域,而是结合现有业务,令其更好地发展。

其次,和A100匹配的相关芯片并没有看到明显增长,需求动力不足。

一般来说,A100 这种高端显卡需求明显变多,往往会带动其他相关芯片的增长。以用到A100的ChatGPT为例,其部署需要大量的大算力计算、存储和数据交互芯片,包括:

AI计算,算力>100TFLOPS的GPGPU或大算力AI芯片

CPU,核数>8的CPU

存储,内存/GDDR/HBM/NVMe

数据交互,Infiniband卡

事实上,存储芯片整体表现堪称最差。在存储芯片现货市场,量价齐跌,整个存储器市场在最近半年里跌没了一半,做内存业务的贸易商,库存清不完,亏损严重,暂时看不到需求触底反弹的迹象。不过,高速数据传输速度的HBM内存芯片几乎已成为ChatGPT的必要配置,新一代HBM(高带宽内存)的需求给原本寒冷的内存市场带来了一丝春天气息。

据报道,自2023年初以来,三星和SK海力士的HBM订单迅速上涨,价格也上涨。一些市场参与者透露,HBM3规格DRAM的价格最近上涨了5倍。HBM的热需求给下行周期的存储行业打了一个“强心针”,SK海力士、三星电子、美光等内存制造商表示,他们将致力于HBM的发展,企业之间的产品开发竞争也在升温。

最后,A100和A800 GPU采用台积电7nm制程工艺,目前该产能利用率处于低迷。去年年底、今年一季度英伟达还分别给台积电下急单、加单,不同于2021年汽车芯片产能不足,供需失衡,台积电要承接目前来自大客户英伟达的A100等GPU订单,产能利用率要经历一个爬坡的过程,并不是陡然上升的,一定程度反映需求端的表现,暂时看不到大起大伏。

台积电7/6nm的产能利用率在2023年上半年不再处于过去3年的高点,去年第三季度末就已跌至90%以下,随着联发科和AMD等多家客户砍单,11月跌至60%,到3月末将不足40%,受6/7nm工艺的产能利用率拖累,台积电今年第一季度整体产能利用率还出现了较大幅度的滑坡(降至75%左右)。

得益于苹果和英伟达等企业的新订单,如A800进入量产,可望逐渐为台积电低迷不振的7nm制程产能利用率解套,市场预计第二季度会止跌,然后缓慢回升。

04

结语

可以看出,市场上A100涨价,更多是商家在AI风口和芯片禁令下的一种投机行为,或许因为销路受到短暂阻塞,利用信息差、资源差,有了抬高物价的理由,但归根结底有没有需求,能不能交易,有可能商家们自己都要打个问号。

如今的芯片市场需要多一些真诚,少一些概念和套路,毕竟芯片整体缺涨的行情已经过去,在近一年的低迷日子里,大家清库存的清库存,转型的转型,很多人早已从一地鸡毛中交了学费,擦亮了眼睛。

参考资料:

[1]熬过“压垮台积电7nm利用率”逆风!英伟达迎来新款GPU大卖,大喊:AI拐点已到,问芯Voice

[2]ChatGPT算力消耗惊人,能烧得起的中国公司寥寥无几,财经十一人

[3]盘点巨头大模型产业链,华西证券