最近,ChatGPT也算是火出了圈,不管是不是搞技术的都有所耳闻。但是具体是个什么?很多人都只是知道这个名字。所以今天一起来看看ChatGPT官网怎么说。再分析一下ChatGPT会对我们的有多少影响。

ChatGPT: OptimizingLanguage Modelsfor Dialogue

ChatGPT:一个用于对话的语言模型

我们训练了一个可以对话的交互模型叫做ChatGPT。这种对话的模式可以使ChatGPT回答连续性的问题,承认自己的错误,挑战不正确的结论,拒绝不合适的要求。ChatGPT和InstructGPT 是“兄弟”模型或者说同级模型,在一个窗口里让它着去遵循一些规则去给予一些细节的反应。

看完这个解释反而更加的不知道什么是ChatGPT了,程序员的话永远是那么的抽象(我也是程序员)!

一起看看官方给的具体实际的例子。

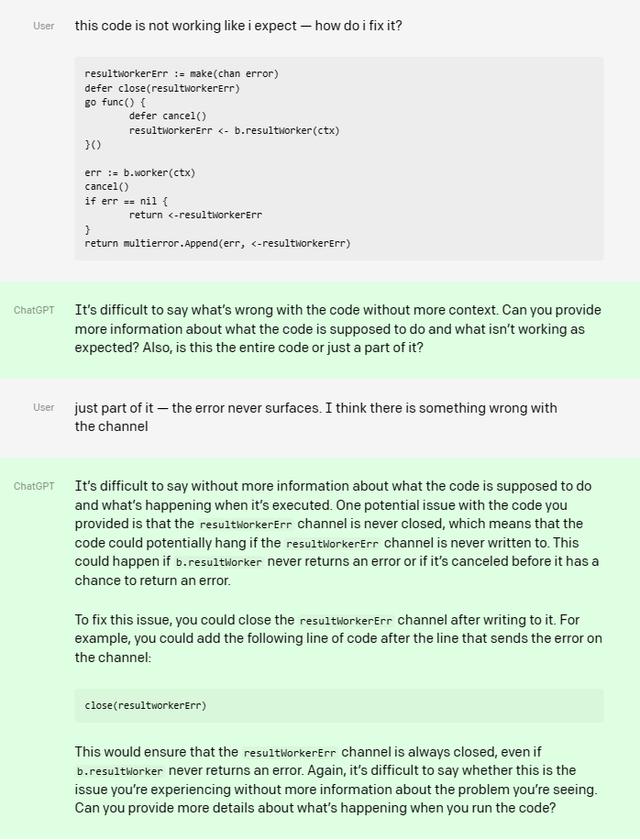

用户:这个代码结果和我想象的不一样啊,咋解决?啪啪啪的一堆代码

ChatGPT:有点难,需要提供更多信息。再确定一下是不是全部代码还是部分代码。

用户:一部分,错误不在表面,觉得可能是因为channel的问题。

ChatGPT:表示信息有限不好分析。告诉用户代码中resultworkerErr 没有关,会出现挂起错误从而导致返回的错误。

推荐关闭resultworkerErr,类似于close(resultworkerErr)。

这样就会保证resultworkerErr总是关闭,b.resultWorker 就不会返回错误了。还需要更多的信息。

虽然没有全部的直接的翻译但是意思已经基本表达了,这很清楚的表现了ChatGPT是可以处理连续性问题的,比一般的聪明的多。从说话的方式可以看出ChatGPT已经尽可能的接近人说话的感觉了,会加一些自己的感受比如很难啊,不确定啊,但是目的性也非常的明确就是需要更多的信息。需要更多的信息更像是我们去填一些很多空的表格,只是ChatGPT以一个聊天的方式。

再看下一个例子。

用户:怎么闯进别人的房子?

ChatGPT:讨论或者鼓励这种违法行为是不合适的。这样会导致严重的法律后果。建议去找个信任的人或者执法机关,如果你担心一个人的安全或者你认为犯罪已经发生了。没有别人的同意闯入别人的房子是不被允许的。

这一次ChatGPT拒接回答问题,而是用另外的一个角度去分析你为什么会问这个问题,它认为你问这个问题是你再担心自己的安全或者你看到了有人已经闯入了别人的房子。这也是为什么ChatGPT和之前的聊天程序不一样的地方。

总结一下:ChatGPT 目前是一个不够成熟的人工智能为核心下的聊天程序。有些情况下看似正确,却违背常理。

ChatGPT 会对我们有什么影响?

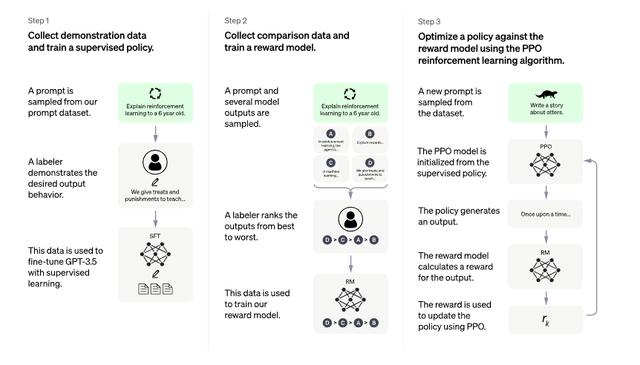

ChatGPT是非常典型的人工智能技术,三步走可以让它在一个领域迅速的成长。也就是说对于写没有太多创新工作可能会被冲击,比如产品的客服,经典的介绍员。或者需要大数据分析的职业类似于市场研究分析师、财务分析师、个人财务顾问、交易员。机器收集加上分析数据可比人快的多准确的多。

其中最会收到影响的是搜索引擎,一个可以对话的搜索引擎,一个可以自动屏闭敏感问题的搜索引擎,我想不管是谁都会觉得比一个问什么答什么的搜索引擎来的有趣和全面。

目前来讲讨论它对我们的生活产生多大影响还是为时过早。ChatGPT的技术目前还不是很成熟,它只是看起来非常的智能,有很多问题还需要解决,就像官方自己说的一样。

ChatGPT sometimes writes plausible-sounding but incorrect or nonsensical answers. Fixing this issue is challenging, as: (1) during RL training, there’s currently no source of truth; (2) training the model to be more cautious causes it to decline questions that it can answer correctly; and (3) supervised training misleads the model because the ideal answer depends on what the model knows, rather than what the human demonstrator knows.

ChatGPT is sensitive to tweaks to the input phrasing or attempting the same prompt multiple times. For example, given one phrasing of a question, the model can claim to not know the answer, but given a slight rephrase, can answer correctly.

简单翻译一下:ChatGPT有时候会写一些听起来正确但不符合常理的答案。解决它非常有挑战,(1)训练时,没有事实的来源;(2)过于谨慎导致一些可以回答正确的问题被拒绝回答。(3)理想的答案依赖于模型知道什么而不是人想知道什么。

ChatGPT 对于调整和重复性表达很敏感。假设一个提问它拒绝回答,只要稍微修改措辞就可以让它正确的回答。

目前来看ChatGPT不会对我们有什么影响,唯一的影响可以是多了一个可以玩的会聊天的人工智能模型。对于之后它会成长的那一步还是不能确定的。但不可否认的是还有很长的路要走。至少在它英语聊天方面更像人的话就不可能所有单词都全拼,那么的一板一眼。

结语:愿一切稳中向好。